EarTouch:面向智能手机的耳势交互系统

视力障碍人群依靠读屏软件与手机交互,通常需要占用双手,以“触摸+听”的方式使用智能手机,单手使用不便:尤其是在移动出行时,一只手被盲杖或导盲犬占用;或在公众场景下,往往要将手机举近耳朵去听。使用扬声器会带来隐私、引起他人关注等问题,使用耳机也有其弊端,如阻隔环境音、不便携等。

耳势交互于电容传感器数据分析的智能算法实现,支持手机识别耳朵在手机屏幕上的接触和移动,从而支持一系列交互功能如接打电话、发送语音消息、快捷导航等。使用耳势交互时,无论是触摸输入、语音输入或是获取反馈,都可以在一个相对稳定轻松的类似打电话的姿态完成。用户可以从从手机上方的听筒听取反馈,在不使用耳机的情况下也能解决泄漏隐私和引起社会关注等问题。

图 盲人现在主要采用的双手姿态 vs 只需单手的耳势交互

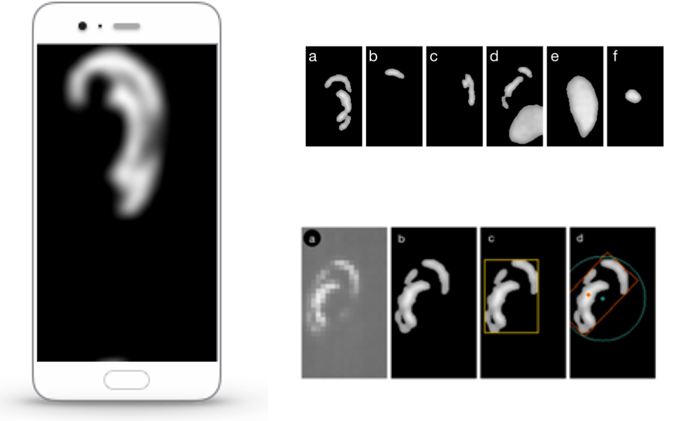

图 识别和分析耳朵接触屏幕时的电容图像

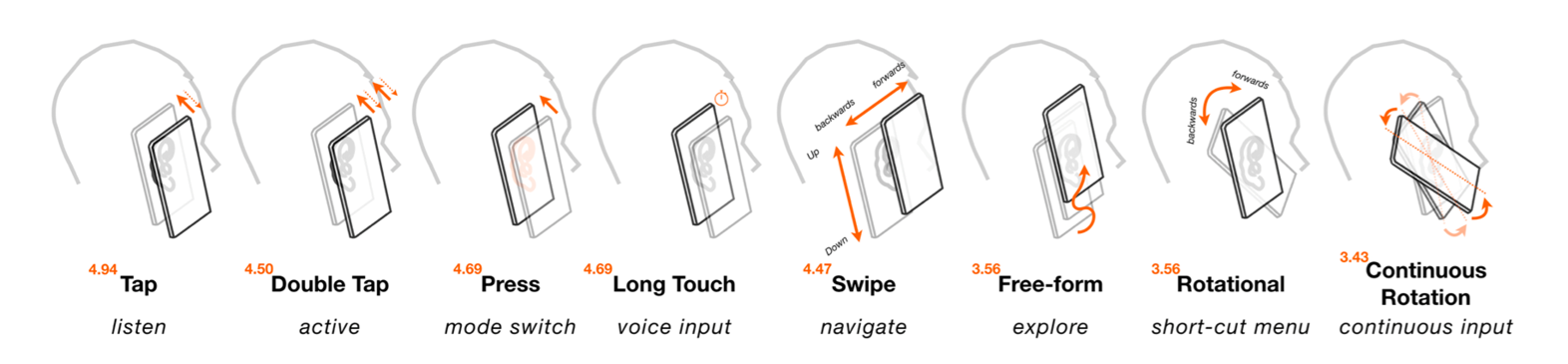

图 与视力障碍用户一同进行设计工作坊后确定的耳势动作及功能集合

(本项目由清华大学无障碍发展研究院副院长、清华人机交互实验室负责人史元春教授团队研发)